인공지능(AI) 기술과 반도체 업계의 관계 및 향후 전망에 대해 설명해 보세요.

[AI 기술과 반도체 업계의 관계]

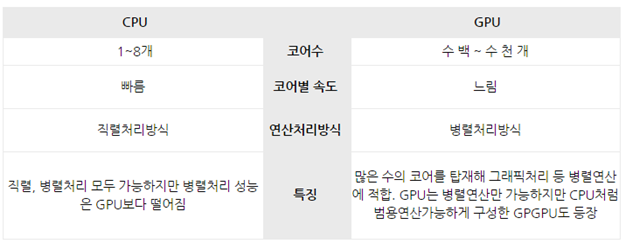

AI 연산, 특히 딥러닝 학습과 추론은 수억~수천억 개의 파라미터를 대상으로 행렬 연산을 반복적으로 수행하기 때문에 병렬 처리 능력이 높은 반도체를 필요로 한다. 이에 따라 GPU(Graphics Processing Unit)와 NPU(Neural Processing Unit)를 중심으로 한 AI 가속기 반도체의 수요가 폭발적으로 증가하고 있다. 또한 AI 모델의 파라미터를 빠르게 읽기 위한 초고대역폭 메모리(HBM) 수요도 함께 급증하고 있다.

[AI 반도체 최신 시장 현황]

2022년 ChatGPT의 등장 이후 대규모 언어 모델(LLM) 학습 및 추론을 위한 AI 반도체 수요가 급격히 증가하였다. NVIDIA의 H100(Hopper, TSMC 4nm, 2023년)·H200(HBM3E 141GB, 2024년)·B200(Blackwell, 2024년) 시리즈가 AI 데이터센터 시장을 주도하고 있으며, NVIDIA의 2024년 연간 매출은 전년 대비 수 배 수준으로 급증하였다. 또한 구글 TPU, AWS Trainium, 삼성전자 Mach-1 등 클라우드 업체들도 자체 AI ASIC 개발에 나서고 있다. HBM3E는 AI GPU 한 개당 수십~100GB 이상 탑재되어 AI 서버의 필수 부품이 되었으며, SK하이닉스가 NVIDIA에 독점적으로 공급하며 시장을 선점하고 있다.

[향후 전망]

향후 AI 반도체는 온디바이스 AI(스마트폰·PC에서의 AI 추론 처리)와 데이터센터용 대규모 학습 두 방향으로 시장이 나뉠 것으로 전망된다. HBM4 등 차세대 고대역폭 메모리와 3D 이종 집적 기술이 AI 반도체 성능 향상의 핵심이 될 것이며, PIM(Processing In Memory)과 같이 연산과 메모리를 통합하는 새로운 아키텍처가 중장기적으로 주목받을 것이다.

커뮤니티 Q&A

위 이론과 관련된 게시글이에요.

이해가 안 되거나 궁금한 점이 있다면 커뮤니티에 질문해 보세요!

게시글 작성하기